沢山実験をする学生や研究者の悩み

よし!実験終了!!

次に、大量にデータ解析をしなくてはと思うと気が重い……。

実験をすればするほど、データが倍々で増えてくる。

そして、グラフの軸を整え、見栄えを調整し、美しい見た目に整えなくてはいけない。

前回の実験の結果と、今回の実験の傾向を比較して知見も整理するたびにExcelを開いて、コピペして……。

このような悩みは、 私自身が、学生実験のレポート作成や、研究での大量のデータ解析の時に痛いほど経験したものです。

そこで、出会ったのが「Python」です。

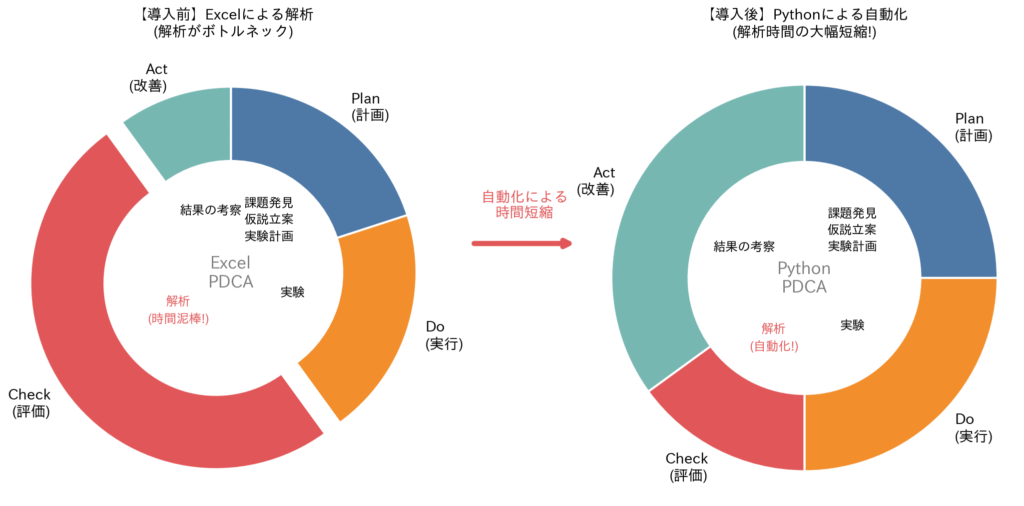

私は、Pythonに出会ってから、以下のような時間配分で研究のPDCAを回せるようになりました。

従来のExcelでは、解析が占める割合が大きかったですが、Pythonにより解析に費やす時間が大幅に短縮され、それ以外の部分に時間を集中させることができるようになりました。

はじめに

私の紹介とブログの全体趣旨

はじめまして、Mr.Pyといいます。

私は、約10年間化学を専門として、某化学大企業の研究者として働いています。

本ブログは、「データ解析をもっと効率化したい」と感じている研究者や学生の皆さんを、Pythonの力で救うために立ち上げました。 また、最近よく耳にする「DX」や「生成AI」を、実際の現場でどう活かすのか知りたい方にも、ヒントとなる情報をお届けします。

私自身が学習を始めた頃、「研究者視点」で実践的なPython活用法を解説している情報が驚くほど少ないと感じました。それが、このブログを書こうと思ったきっかけです。

皆さんがデータ解析に費やしている時間を極限まで圧縮し、本来の研究効率を飛躍的に高める一助になれば幸いです!

Pythonスキルをどのように身に着けたか?

私は学生時代にPythonを独学し、あえて「学生実験レポートの解析をPythonだけでやる(Python縛り)」というルールを課してスキルを磨いてきました。

その結果、作成したグラフの美しさと正確さが評価され、レポートの評価は毎回「100点満点」でした。

また、これまでExcel解析が当たり前だった大学の研究室に、初めてPython文化を持ち込んだのも私です。 私が卒業した後も、研究室ではPythonが解析のスタンダードとなり、私が書いたコードが今なおベースとして使われ続けています。

もちろん現在も、現役の研究者として仕事でPythonをフル活用しています。 自身の経験から、「Pythonスキルは、一度身につければ一生使えるポータブルスキルになる」と日々実感しています。

本記事の目的

そこで、本記事ではまず、従来常識的だったExcelでの解析方法と、Pythonの解析メリットを比較していきたいと思います。

Excelでのデータ解析

これまでの実験の情報処理の常識

まず、皆さんは、実験のデータ解析は何を使っていますか?

大半の人がまず頭に思い浮かぶのが「Excel」かと思います。

日本でトップの理工系大学や高専の授業の中でも、情報処理といえばExcelが主な常識的な解析手法になっているかと思います。

ここで、一度常識となっているExcelのメリットや特徴を振り返ろうと思います。

Excelデータ解析のメリット

Excelでのデータ解析のメリットは以下だと考えています。

- 直感的なGUI:

ExcelやWordなどのOffice系のアプリは特にGUIが豊富にあります。 - お手軽にデータの傾向を見ることができる:

Excelでは、データを「Shift+マウス選択」を使うだけで簡単にグラフを作成することができるかと思います。 - 生データが表形式ですべての数値を漏れなく目視確認できます。:

Excelは表形式でデータを入力するのですべてのデータを見ることができます。 - 多くの関数が用意されている。:

Excelには「VLOOKUP関数」など多くの関数が用意されています。 - 多くの大学や高専の情報処理で初めに学ぶスキル:

私が学生時代の頃は情報処理=Excelの授業というような感じでした。

このように、多くの人はExcelでのデータ処理に慣れ親しんできたかと思います。

Excelでのデータ解析の課題

しかし、このExcelを使ったワークフローには実は多くの問題点があると感じました。

- 処理が重い:

アップデートやGUI操作のせいで、PCの動作が重くなりがちです。特にソルバーなどアドインを適用するとさらに重くなります。 - ライセンスが必要である:

Excelは課金が必要となります。そのため、大学を卒業後にExcelを使うためには再度ライセンスを取得する必要があります。 - データ消失のリスク:

データ数が多くなるとフリーズし、最悪の場合、解析データが消えてしまうこともあります。 - ヒューマンエラー:

繰り返しのGUI操作は、人為的なミスの温床です。データの取り違えや操作ミスは、解析結果の信頼性を低下させます。 - 再現性の低さ:

複雑な関数や手作業のプロセスは、他の人が見ても理解しにくく、解析の再現が困難です。 - 非効率な繰り返し:

すべての解析を毎回ゼロからスタートするため、時間対効率が低いままです。特にグラフの体裁は、毎回手直しが必要ですし、時間をかけた割に綺麗なグラフになりません。

これらの問題に対して実は気づかないうちに、皆さんの労力と時間が浪費されているのです。

なぜPythonなのか? データ解析自動化のメリット

そこで、Pythonは、これらの問題を解決する強力なツールとなります。

私はぜひ、Pythonを今後の常識的な、解析ツールとしていただきたい!

Pythonでのデータ解析自動化のメリット

以下にPythonでのデータ解析のメリットを整理します。

- 完全無料:

Pythonは完全に無料です。どの端末でも、Pythonを使うことができます。 - 豊富なライブラリと拡張性:

データ解析はもちろん、ExcelやPowerPointの自動作成、PDF処理、メール送受信、画像処理、機械学習まで、基本的にどのような定型作業でも自動化できます。 - 定型作業のヒューマンエラーの撲滅:

一度正しくコードを組んでしまえば、面倒なGUI操作は不要になります。これにより、データの取り違えや操作ミスといったヒューマンエラーを劇的に減らすことができます。 - 圧倒的な将来性:

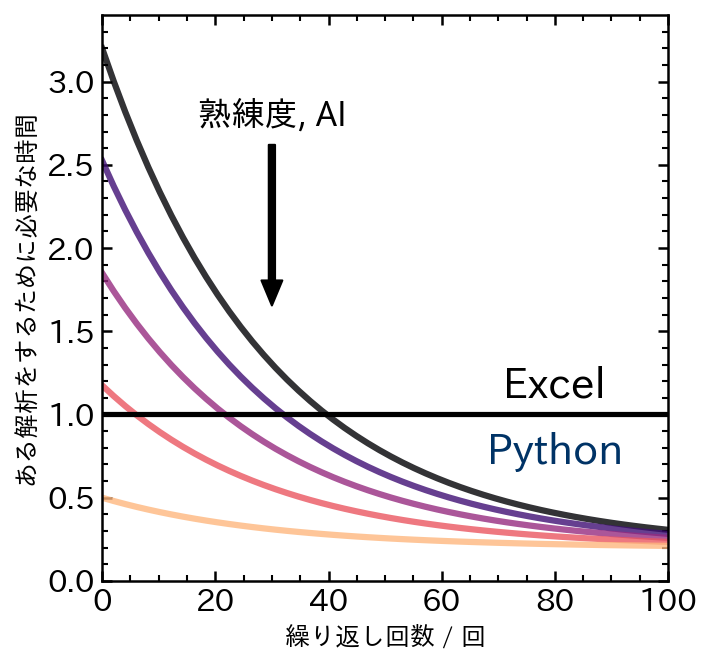

下のグラフは、私が感じるExcelとPythonの習熟度に対する生産性のグラフです。Excelの習熟度には限界がありますが、Pythonは学べば学ぶほど生産性が向上します。最初はコード作成に時間がかかっても、一度自動化してしまえば、将来にわたってあなたの時間を節約し続けてくれるのです。 - 世界で一番簡単な言語:

Pythonは、プログラミング言語の中でも特に学びやすいとされています。そして、インターネット上に多くの有益な情報があります。 - AIとの親和性:

ChatGPTやGeminiなどの生成AIのPythonレベルが非常に高く、AIが優れたPythonコードを出力してくれますし、またやりたいこともPythonコードで伝えることができます。

(完全主観) PythonとExcelの「労力」の比較

このグラフは、これまでの私の経験ベースで描いた仮説である、ある一つの解析作業にかかる時間(縦軸)と、その作業を繰り返す回数(横軸)の関係を表しています。

- Excel(黒線): 1回目も100回目も、かかる時間は変わりません。毎回同じようにマウスをカチカチ動かし、コピペをする必要があります。「定数関数的」に時間が奪われ続けます。

- Python(カラーの線): 最初の1回目(左端)は、コードを作成する必要があるため、Excelよりも時間はかかってしまいます。 しかし、2回目以降を見てください。 1度コードが書ければ、エンターキーを1回押すだけで解析が終わるため、かかる時間はほぼ「ゼロ」に近づきます。また、他のコードで作成した関数を別の解析に移植することもできるため、書けば書くほど効率化していきます。 さらに注目してほしいのが、「AI」の存在です。 昔はプログラミングの習得(熟練度)に何年もかかりましたが、今はChatGPTやGeminiなどのAIに手伝ってもらうことで、初期コスト(グラフの開始位置)を劇的に下げることができます。

つまり、「AI × Python」を使えば、ほんの数回の繰り返しですぐにExcelの効率を追い抜けるのです。

実際にPythonで効率化できた具体例

以下にPythonによって効率化したと感じる具体例をいくつか示します。

- 100個のcsvファイルを自動で読み込んでヒストグラムで平均や標準偏差を整理する。:

Excelでは1ファイルずつ開いてグラフを作成し、 体裁を整える作業を100回繰り返す必要があります。 Pythonなら、全ファイルを一括で読み込み、 統一された美しいグラフを数秒で自動生成できます。 - 各条件でN=5の試験をした場合のデータ解析等。

5サンプル×3条件×N=5回の試験データ (合計75データポイント)の統計処理も、 コード1つで平均・標準偏差まで 自動で完了します。体裁の修正も一括で修正が可能となります。 - ピーク分離やオリジナル関数でのフィッティングする。

Pythonでのデータ解析のデメリット

もちろん、Pythonも万能ではありません。導入にあたっての壁も存在します。

一番のハードルになると考えられるのが、 「環境構築」 です。

Pythonは自分でインストールし、環境を整える必要があります(だいぶ楽にはなりましたが…)。

しかし、 一度乗り越えてしまえば、その先には快適な自動化ライフが待っています。

結論:コードは「資産」、作業は「消費」

結論です。

結論

Pythonでのコード作成やスキルは、時間を「投資」して「資産化」できます。

研究活動は「繰り返し」の連続です。 条件を変えて実験する、N数を増やす、パラメータを変えて再解析する……。

そのたびにExcelで同じ作業を繰り返すのか、それともPythonという「資産」を作って2回目以降を自動化するのか。

グラフで示した通り、AIの進化によって「Pythonという資産」を作るハードルは驚くほど低くなっています。

「またこの作業か…」とため息をつく前に、 まずはAIに「このExcel作業をPythonで自動化したい」 と相談することから始めてみませんか?

次回の記事では、Python環境構築の最短ルートを ステップバイステップで解説します。 誰でも30分以内に、最初のPythonコードを 動かせるようになります。 それが、あなたの研究ライフを劇的に変える 第一歩になります。

コメント